在老齡化社會,臨終關懷(End-of-life Care)的需求無疑會呈現增長態勢。然而,傳統的臨終關懷照護十分依賴醫護人員經驗和技能,往往缺乏系統性,不容易實踐嚴謹的循證醫學,護理上也容易出現質素不穩定、資源使用效率不高等問題。因此,藉助現代科技來提高臨終關懷的質素和效率,是有吸引力的。

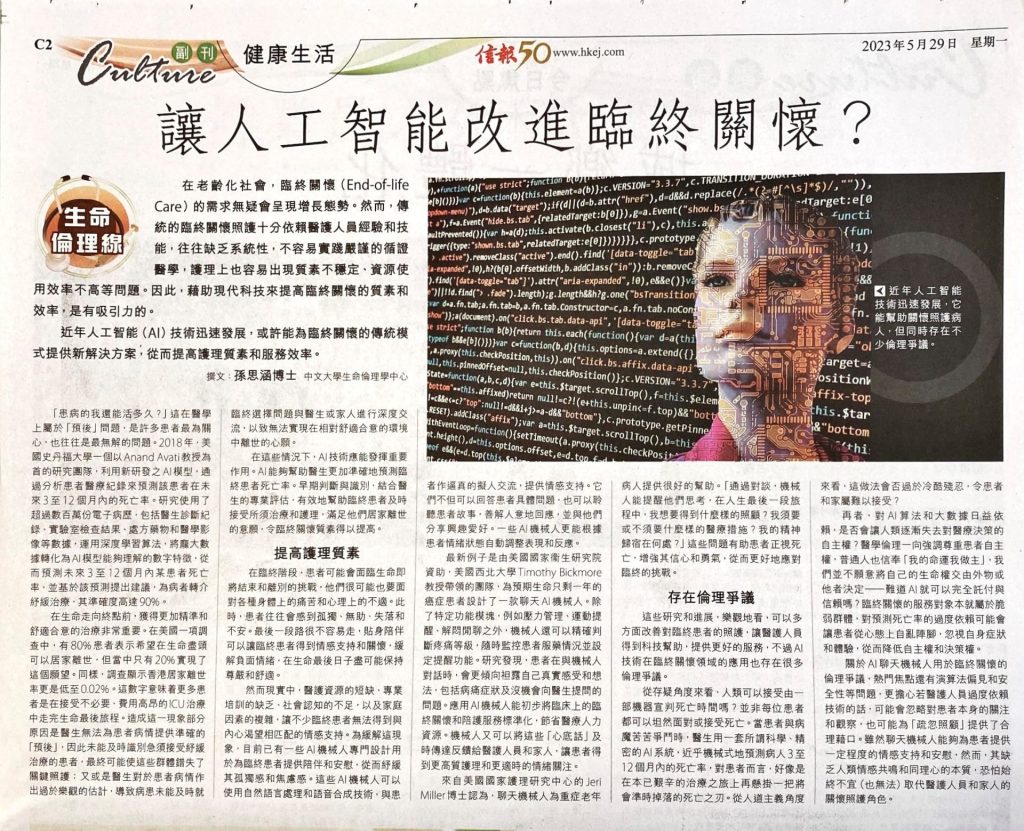

近年人工智能(AI)技術迅速發展,或許能為臨終關懷的傳統模式提供新解決方案,從而提高護理質素和服務效率。

「患病的我還能活多久?」這在醫學上屬於「預後」問題,是許多患者最爲關心,也往往是最無解的問題。2018年,美國史丹福大學一個以Anand Avati教授爲首的研究團隊,利用新研發之AI模型,通過分析患者醫療記錄來預測該患者在未來3至12個月内的死亡率。研究使用了超過數百萬份電子病歷,包括醫生診斷紀錄、實驗室檢查結果、處方藥物和醫學影像等數據,運用深度學習算法,將龐大數據轉化爲AI模型能夠理解的數字特徵,從而預測未來3至12個月内某患者死亡率,並基於該預測提出建議,為病者轉介紓緩治療,其準確度高達90%。

在生命走向終點前,獲得更加精準和舒適合意的治療非常重要。在美國一項調查中,有80%患者表示希望在生命盡頭可以居家離世,但當中只有20%實現了這個願望。同樣,調查顯示香港居家離世率更是低至0.02%。這數字意味着更多患者是在接受不必要、費用高昂的ICU治療中走完生命最後旅程。造成這一現象部分原因是醫生無法為患者病情提供準確的「預後」,因此未能及時識別急須接受紓緩治療的患者,最終可能使這些群體錯失了關鍵照護;又或是醫生對於患者病情作出過於樂觀的估計,導致病患未能及時就臨終選擇問題與醫生或家人進行深度交流,以致無法實現在相對舒適合意的環境中離世的心願。

在這些情況下,AI技術應能發揮重要作用。AI能夠幫助醫生更加準確地預測臨終患者死亡率。早期判斷與識別,結合醫生的專業評估,有效地幫助臨終患者及時接受所須治療和護理,滿足他們居家離世的意願,令臨終關懷質素得以提高。

提高護理質素

在臨終階段,患者可能會面臨生命即將結束和離別的挑戰,他們很可能也要面對各種身體上的痛苦和心理上的不適。此時,患者往往會感到孤獨、無助、失落和不安。最後一段路很不容易走,貼身陪伴可以讓臨終患者得到情感支持和關懷,緩解負面情緒,在生命最後日子盡可能保持尊嚴和舒適。

然而現實中,醫護資源的短缺、專業培訓的缺乏、社會認知的不足,以及家庭因素的複雜,讓不少臨終患者無法得到與内心渴望相匹配的情感支持。為緩解這現象,目前已有一些AI 機械人專門設計用於為臨終患者提供陪伴和安慰,從而紓緩其孤獨感和焦慮感。這些AI機械人可以使用自然語言處理和語音合成技術,與患者作逼真的擬人交流,提供情感支持。它們不但可以回答患者具體問題,也可以聆聽患者故事,善解人意地回應,並與他們分享興趣愛好。一些AI機械人更能根據患者情緒狀態自動調整表現和反應。

最新例子是由美國國家衛生研究院資助,美國西北大學的Timothy Bickmore教授帶領的團隊,為預期生命只剩一年的癌症患者設計了一款聊天AI 機械人。除了特定功能模塊,例如壓力管理、運動提醒、解悶閒聊之外,機械人還可以精確判斷疼痛等級,隨時監控患者服藥情況並設定提醒功能。研究發現,患者在與機械人對話時,會更傾向袒露自己真實感受和想法,包括病痛症狀及沒機會向醫生提問的問題。應用AI機械人能初步將臨床上的臨終關懷和陪護服務標準化,節省醫療人力資源。機械人又可以將這些「心底話」及時傳達反饋給醫護人員和家人,讓患者得到更高質護理和更適時的情緒關注。

來自美國國家護理研究中心的Jeri Miller博士認為,聊天機械人為重症老年病人提供很好的幫助。「通過對談,機械人能提醒他們思考,在人生最後一段旅程中,我想要得到什麽樣的照顧?我須要或不須要什麽樣的醫療措施?我的精神歸宿在何處?」這些問題有助患者正視死亡,增強其信心和勇氣,從而更好地應對臨終的挑戰。

存在倫理爭議

這些研究和進展,樂觀地看,可以多方面改善對臨終患者的照護,讓醫護人員得到科技幫助,提供更好的服務,不過AI技術在臨終關懷領域的應用也存在很多倫理爭議。

從存疑角度來看,人類可以接受由一部機器宣判死亡時間嗎?並非每位患者都可以坦然面對或接受死亡。當患者與病魔苦苦爭鬥時,醫生用一套所謂科學、精密的AI 系統,近乎機械式地預測病人3至12個月内的死亡率,對患者而言,好像是在本已艱辛的治療之旅上再懸掛一把將會準時掉落的死亡之刃。從人道主義角度來看,這做法會否過於冷酷殘忍,令患者和家屬難以接受?

再者,對AI算法和大數據日益依賴,是否會讓人類逐漸失去對醫療決策的自主權?醫學倫理一向強調尊重患者自主權,普通人也信奉「我的命運我做主」,我們並不願意將自己的生命權交由外物或他者決定——難道AI就可以完全託付與信賴嗎?臨終關懷的服務對象本就屬於脆弱群體,對預測死亡率的過度依賴可能會讓患者從心態上自亂陣腳,忽視自身症狀和體驗,從而降低自主權和決策權。

關於AI聊天機械人用於臨終關懷的倫理爭議,熱門焦點還有演算法偏見和安全性等問題,更擔心若醫護人員過度依賴技術的話,可能會忽略對患者本身的關注和觀察,也可能為「疏忽照顧」提供了合理藉口。雖然聊天機械人能夠為患者提供一定程度的情感支持和安慰,然而,其缺乏人類情感共鳴和同理心的本質,恐怕始終不宜(也無法)取代醫護人員和家人的關懷照護角色。